Как использование ИИ может навредить клиентскому опыту

Улучшения в автоматизации и искусственном интеллекте, происходят ежедневно. Они меняют и улучшают то, как устроен наш мир. Особенно это актуально в сфере CX. Можно сказать, что организациям и их руководителям очень повезло, ведь сегодня у них есть доступ к сотням платформ искусственного интеллекта, каждая из которых устраняет различные пробелы в клиентском опыте, услугах и эффективности. Да, у всех этих решений есть свои собственные подходы, плюсы и минусы, а также алгоритмы, направленные на улучшение и упрощение клиентского опыта (CX) и повышение производительности организации в глазах клиентов.

На момент начала пандемии, ИИ уже не первый год решал проблемы и улучшал клиентский опыт, но именно в этот период все типы организаций обратили свое внимание на ИИ, и многие стали внедрять его в рабочие процессы. Имея такое разнообразие вариантов решения проблемы «дефицита клиентов», нам нужно на секунду сделать шаг назад и проанализировать, как каждое решение будет отвечать потребностям наших клиентов, а также какие риски оно будет представлять для нашего бренда и его репутации, если мы не используем его ответственно и осторожно.

При правильном внедрении ИИ может снизить затраты, положительно сказываясь на времени ожидания, численности персонала и эксплуатационных расходах в любой точке взаимодействия, отвечая на вопросы намного быстрее и точнее, чем человек.

Уже сейчас можно с уверенностью сказать, что в ближайшем будущем будет все сложнее распознать разницу между взаимодействиями человека и ИИ. Поскольку столь стремительный прогресс простимулирован нынешней пандемией, нам нужно подумать о том, что действительно может решить проблемы для клиентов таким образом, чтобы улучшить наши бренды и репутацию.

Ключевые моменты, недавно представленные главным специалистом по этике ИИ BCG GAMMA Стивеном Миллсом, вместе с Элиасом Балтассисом, Максимилиано Сантинелли, Кэти Карлиси, Сильвеном Дюрантоном и Андреа Галлего (также из BCG GAMMA), затрагивают намерение, этику, принципы, ответственное использование и реальность внедрения ИИ-решений.

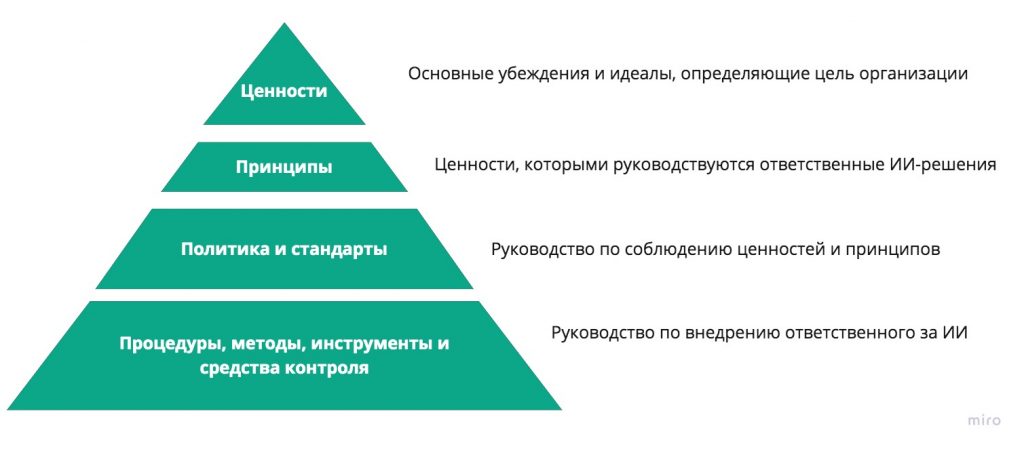

В таблице ниже рисунке представлены наиболее важные аспекты начала ответственной инициативы ИИ, призванной обеспечить принятие клиентами.

Физический и цифровой опыт объединяются, равно как и такие технологии, как ИИ, Интернет вещей (IoT), сверхчувствительные датчики, а также VR и AR, которые призваны предложить потребителям ряд улучшенных возможностей.

Чем больше данных мы получаем и чем лучше понимаем триггеры клиентов, тем больше мы узнаем о том, что побуждает компании и частных лиц совершать покупки или оставаться с нами в качестве клиента. Дополнительное преимущество: мы учимся гипер-персонализировать их опыт. В конце концов, многие технологии зависят от одних и тех же вещей: эмоций, опыта, услуг и аналитики данных, а также от ценности вашего решения и его способности решать проблемы клиентов.

По мере того, как улучшается способность переваривать и анализировать данные, компании будут разрабатывать более совершенные алгоритмы для получения полного представления о клиенте. Чем больше мы будем использовать автоматизацию на базе ИИ в операциях по обслуживанию клиентов, тем больше мы можем предоставлять максимально быстрые и эффективные решения и качественное обслуживание.

Что бы мы хотели сделать в будущем и что происходит сейчас? Ниже приведены три основных направления.

Избегать инвазивных технологий

Технологические риски связаны с этическими проблемами, связанными с использованием ИИ. Согласно недавнему отчету Futurum Research, главная задача заключается в том, чтобы полностью избежать или уравновесить необходимость извлечения данных для анализа и внедрения технологий, которые могут быть восприняты как грубое вмешательство в жизнь клиента.

Согласно отчету, 47% потребителей заявили, что обращение за помощью к ИИ-помощникам (например, Алекса, Сири и т.д.) — хороший способ получить информацию быстрее, но 38% признали, что у них есть опасения по поводу личного вмешательства и работы с технологией.

Некоторые технологии, которые могут быть частью иммерсивного опыта или живых сервисов , также могут быть проблематичными. Например, в программных решениях B2B можно столкнуться с аналогичными проблемами. Разница будет в том, что технологии используются для продвижения нашей компании вперед, а не по сугубо личным причинам.

Граница между ограничениями, этикой и ее отсутствием

Где стоит провести разграничительную черту в отношении ИИ, анализа и сбора данных? Однозначного ответа на данный вопрос нет, так как до сих пор все страны рассматривают это по-своему. По мере развития технологий, которые так тесно связаны между собой: робототехники, межмашинного взаимодействия, беспилотных летательных аппаратов, Интернета вещей, ИИ, анализа данных и т.д., — нам необходимо определить направления для всех. Это похоже на ядерное соглашение: если только США и Россия подпишут его, у остальных ядерных держав по-прежнему будет свобода действий.

В течение многих лет ИИ успешно использовался в самых разных секторах: от чат-ботов до автомобильной промышленности. Проще задать вопрос о том, где ИИ еще не используется?

Задача состоит в том, чтобы поставить этику выше приоритетов совета директоров, которые ставят прибыль выше людей. Хотелось бы сказать, что это кануло в прошлое, но многие компании все еще ориентированы на достижение этой цели, даже если это непреднамеренно. И речь не о том, что прибыль не является или не должна быть целью бизнеса. Прибыль важна, но справедливость по отношению к клиентам должна рассматриваться выше любых корыстных интересов.

Прибыль часто является результатом значительной и желанной этической работы для сотрудников, клиентов, партнеров и заинтересованных сторон. К сожалению, у нас до сих пор есть компании, которые непреднамеренно (?) разрушают доверие клиентов, а в некоторых случаях даже были осведомлены об этой проблеме.

Это может существенно повлиять на любые уже предпринятые попытки развить доверие к бренду. Даже если ваш CX будет восприниматься как отличный, при малейшем нарушении доверия вы потеряете свои ключевые активы: сотрудников и клиентов.

Клиенты зачастую предпочитают ИИ и машинное обучение (ML). И компании, и клиенты одинаково извлекают выгоду из этих дополнительных технологий. Все мы, судя по недавнему опросу BCG, жаждем чего-то довольно простого. Общественность хочет видеть ответственность и принципы, наряду с программами обучения, чтобы гарантировать, что все основано на надежных фреймворках, которые будут всеми приняты и усвоены.

высокопроизводительных систем с более надежными и объяснимыми результатами.

Это не так уж и много для технологии, которая приносит все большую пользу людям и предприятиям. Есть несколько способов решить эту проблему, но самый главный из них основан на культуре вашей организации. Именно культура по-прежнему является ключевой частью вашей компании, поскольку она помогает сотрудникам и руководителям должным образом передавать её ценности и принципы, разрабатывать для них план выполнения, а затем выполнять его.

Та же ситуация и с ИИ. Вам нужен лидер, который будет управлять искусственным интеллектом в вашей организации, как ваш топ-менеджер делает это с другими объектами, такими как CIO, CMO и CCO. Руководитель ИИ или бизнес-аналитики должен определять и распространять культуру этики для ИИ в компании, жить и проповедовать этику, а также создать правильные команды и руководство наряду с надлежащими инструментами для управления принципами компании. Другое, но гораздо более сложное решение — это уже сейчас заключить глобальное соглашение между ведущими странами, использующими и развивающими ИИ в различных областях.

Главный результат ИИ-управления и программы, организованной руководством, — является разработка основы для руководства развитием услуг и продуктов в соответствии с определенными заранее установленными правилами. Это убрало бы пропасть между руководством, руководителями НИОКР, дизайнерами, заказчиками и другими сотрудниками. Одним из примеров организации, работающей в этой области, является RIKEN — один из крупнейших исследовательских институтов в Японии, который в настоящее время обсуждает именно эти темы, чтобы управлять балансом между японскими клиентами и компаниями.

Защищать интересы сотрудников и клиентов

Представьте, что этика победила. И, представьте себе настоящее и, немного забегая вперед, будущее, когда мы поймем, что ИИ будет сможет решать определенные вещи, а потом, и гораздо нечто большее. Что произойдёт, если будет принято неверное решение? Исходя из первоначальной схемы, проблемы такого характера можно было бы смягчить заранее, установив процедуры, позволяющие сотрудникам, клиентам и партнерам оспаривать решения — независимо от того, считаются ли они предвзятыми, несправедливыми или даже дискриминационными.

По мере того, как компании все больше внедряют эти технологии и связанные с ними решения, клиенты должны просить об использовании прозрачной политики в области искусственного интеллекта и заявлений об искусственном интеллекте, чтобы обеспечить справедливый способ ведения бизнеса. Что необходимо сделать для обеспечения прозрачности и справедливости?

Парадокс этики в ИИ

Мы должны убедиться, что защита и доверие потребителей обеспечены, что правила ЕС по безопасности и ответственности за продукты и услуги соответствуют целям в эпоху цифровых технологий.

Петра Де Суттер, член партии «Зелёные». Действующий вице-премьер и министр по делам госслужбы и государственных организаций в кабинете Де Кро

Речь идет о том, как разрабатывать и внедрять технологии, обеспечивающие защиту клиентов и сотрудников, а также прозрачность компаний. Рассматривая тему ИИ и прозрачности для клиентов, следует задаться следующими вопросами:

- Как компании будут обеспечивать защиту потребителей от недобросовестной и дискриминационной коммерческой практики, а также от рисков, связанных с решениями и услугами на основе ИИ?

- Каким образом бизнес будет гарантировать большую прозрачность этих процессов?

- Как компании будут гарантировать, что только высококачественные и непредвзятые наборы данных используются в системах алгоритмических решений?

Да, автоматизация и ИИ могут ускорить процесс подключения клиентов к решениям. Однако без того, чтобы люди продолжали находить и документировать решения, проверять выводы ИИ и обеспечивать работу автоматизации, технология принесла бы больше вреда, чем пользы. Очевидно, что технологии будут продолжать менять то, что есть в сфере обслуживания клиентов, но эту трансформацию возглавят люди с новыми и разными возможностями, появившимися вслед за этим изменением.

Написать комментарий

Комментарии